Ein Beitrag in eigener Sache: Mitte Mai diesen Jahres – heute vor genau 3 Monaten – bin ich als Head of Engineering zu NEURA Robotics gewechselt. NEURA ist ein noch recht junges deutsches Robotik-Startup, das spätestens seit dem öffentlichkeitswirksamen Zugang von Till Reuter für mächtig Aufmerksamkeit sorgt … und noch weiter sorgen wird. Wohl aufgrund der hohen Dynamik und Geschwindigkeit im Unternehmen fühlt es sich mittlerweile tatsächlich schon nach mehr als 3 Monaten an.

Als Head of Engineering hab ich dort Verantwortung über die Engineering-Departments, sowohl Software als auch Hardware (Mechanik, Elektronik, Mechatronik). Damit darf ich neue Entwicklungen koordinieren und unterstützen und überall dort mitmischen, wo es interessant ist. Meiner Meinung nach ist nämlich genau diese Wechselwirkung zwischen Software, Hardware und KI das, was Robotik so spannend macht und in der noch so viel Potential liegt.

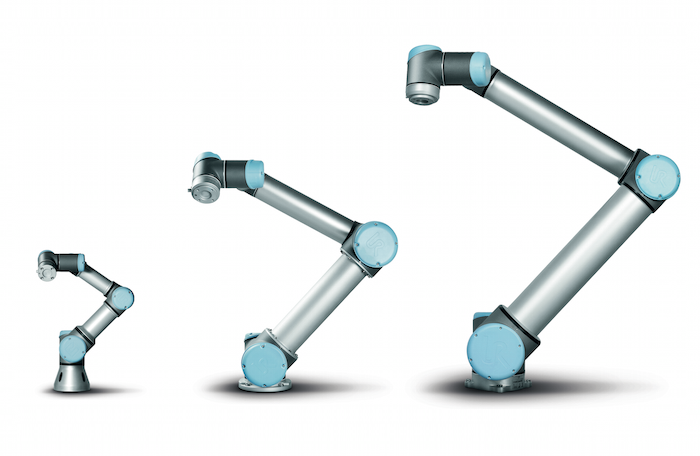

KI ist dabei bei NEURA nämlich von Anfang an direkt mit und in den Roboter integriert. Neben der beeindruckenden Performance der Roboter-Hardware an sich ist NEURA Robotics nämlich stolz darauf, den ersten kommerziell verfügbaren kognitiven Roboter der Welt zu bauen. Kognitive Roboter sind dabei eine Roboterklasse, die erst von NEURA so richtig geschaffen wurde. Sie meint kollaborative Roboter, die über zusätzliche kognitive Fähigkeiten verfügen, um noch flexibler einsetzbar zu sein und natürlich(er) mit Menschen zu interagieren.

Neben der Head of Engineering-Stelle an sich hat mich genau der Teil überzeugt, den sicheren Schoß der Bosch Forschung zu verlassen. Seit meinem ersten Kontakt mit NEURA bin ich nämlich von der Tatsache fasziniert, jetzt die Art Roboter Wirklichkeit werden zu lassen, an denen ich schon zu meiner Promotionszeit – damals allerdings noch unter Laborbedingungen – geforscht habe und von denen wir uns damals ausgemalt haben, dass es sie vielleicht eines Tages auch außerhalb des Labors im kommerziellen Einsatz geben wird. Die Zukunft ist da!

Disclaimer: Der Autor dieses Beitrags ist Mitarbeiter der NEURA Robotics GmbH. Die Inhalte des Blogs vertreten ausschließlich Meinungen und Ansichten des Blog-Betreibers und sind nicht als Unternehmensmeinung zu verstehen. Der offizieller Blog von NEURA findet sich hier.